告警:白嫖ollama API,发布到公网的请谨慎

2T超大容量网盘!点击领取 >> 原画质高清备份,上传下载不限速

今天看到很多博主在说ollama的各种问题,包括对开源llama.cpp的道义问题。

不扯这些。

先说说ollama的特性

Ollama 默认没有任何身份验证,不需要API秘钥,而且默认端口11434也是众所周知。所以你只要知道ip地址,大概率可以连通。

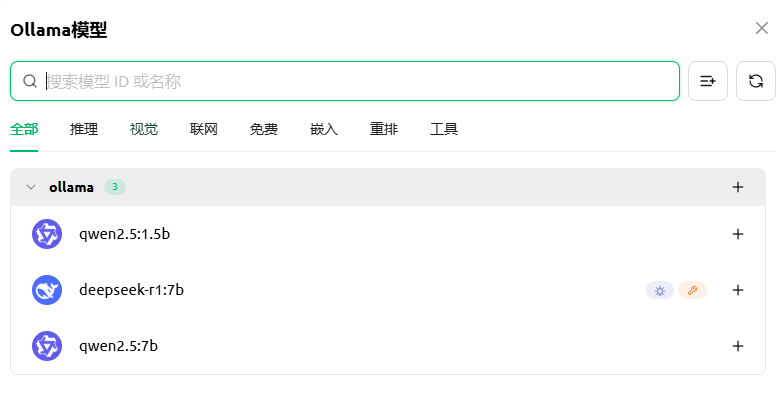

而且连通后,你用AI客户端工具就能看到这个IP地址的ollama上安装了什么本地模型。

危不危险。

如果被人连接了,你的电脑资源可能被大量挤占,甚至宕机。

我看到B站有博主做了试验,于是我试了试,真的劝大家,

第一步改端口

第二步加秘钥

第三步不要发布到公网

第四步放弃ollama部署

试验步骤如下:

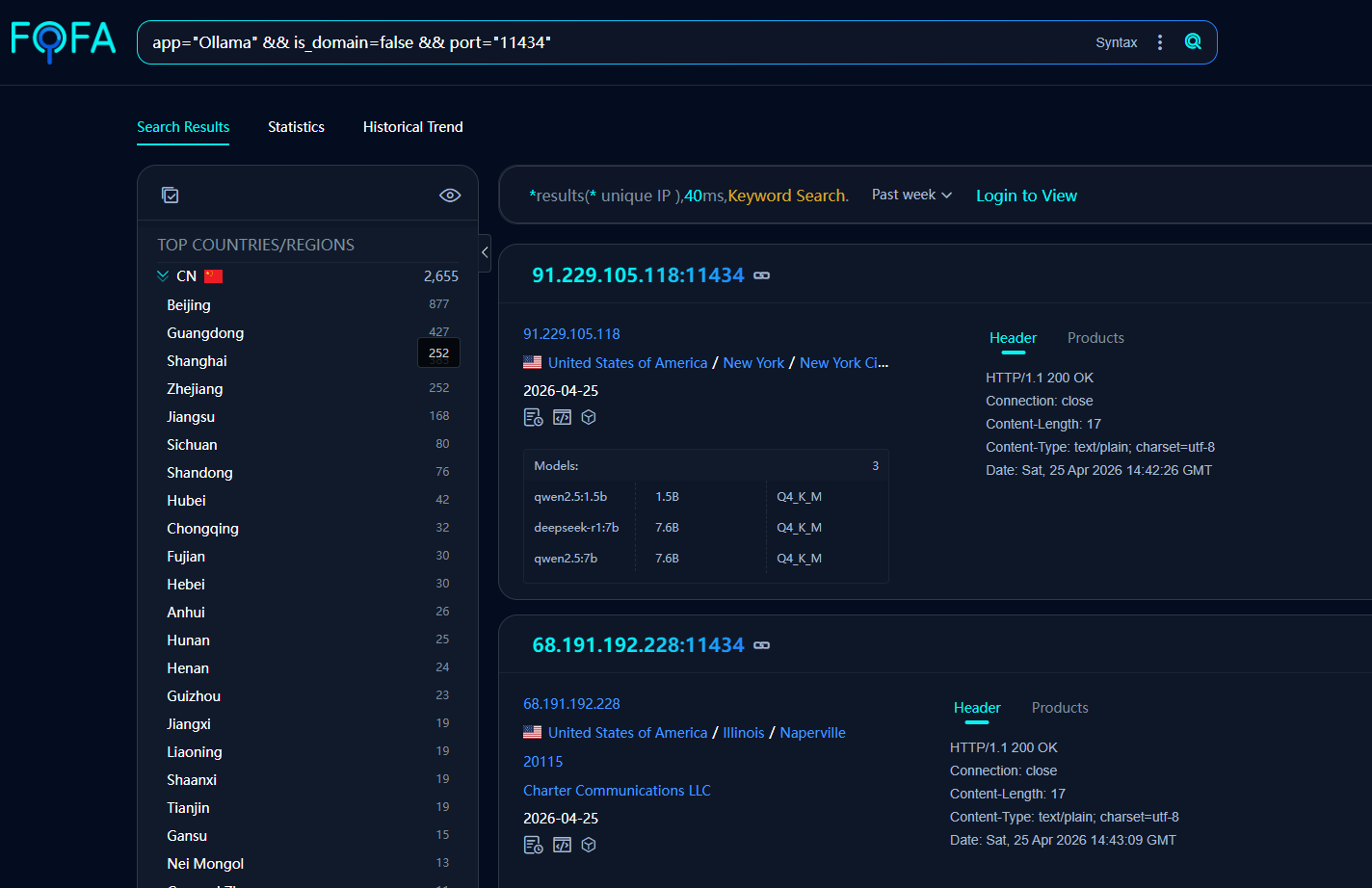

搜索可能的ollama服务,端口11434

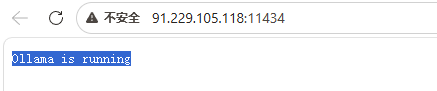

点击搜索结果的连接,你会发现“Ollama is running”,确认无疑了

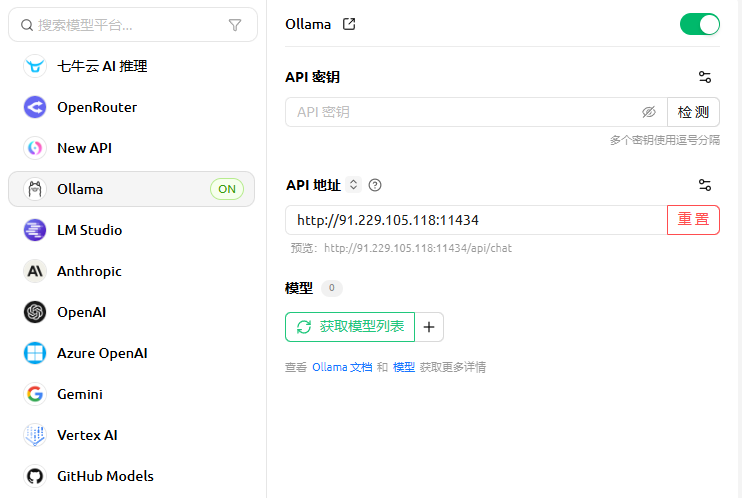

将地址复制到AI客户端,获取模型列表

你再看

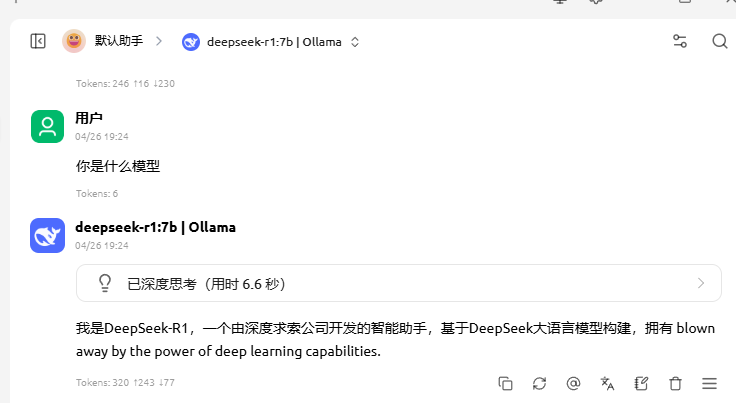

“+”号添加,试试对话。

完全没问题,这还了得。

不做好安全防护工作,那岂不是说进就进。

有类似情况的朋友们抓紧整改吧,不然你都不知道自己的电脑怎么总是资源跑满。

2T超大容量网盘!点击领取 >> 原画质高清备份,上传下载不限速

当前文章作者名:塔林

当前文章标题:告警:白嫖ollama API,发布到公网的请谨慎

当前文章地址:https://www.2109.top/3516/

来源:2109博客 地址:https://2109.top 文章版权归作者所有,未经允许请勿转载。

转载及其他合作需求请微信联系博主

当前文章标题:告警:白嫖ollama API,发布到公网的请谨慎

当前文章地址:https://www.2109.top/3516/

来源:2109博客 地址:https://2109.top 文章版权归作者所有,未经允许请勿转载。

转载及其他合作需求请微信联系博主

THE END